El trilema de la gobernanza

Los retos para la democracia global en la era de la IA

15 de julio de 2024

por

Marta Cantero Gamito

La inteligencia artificial (IA) ha revolucionado —y promete revolucionar— diversos aspectos de nuestras vidas, desde la forma en que trabajamos y nos comunicamos hasta cómo tomamos decisiones y gestionamos nuestras sociedades. Sin embargo, y como es de sobra conocido, la rápida evolución de la tecnología también conlleva desafíos y riesgos significativos, creando un complejo trilema que tanto responsables políticos, expertos técnicos, tecnólogos como la sociedad en general, deben abordar.

Ya de partida, esta elección implica realizar un complejo equilibrio entre la innovación, la regulación y las dinámicas geopolíticas, cada una de las cuales ejerce una influencia profunda en el desarrollo y la implementación de la IA. A su vez, no obstante, el trilema se centra en la imposibilidad de la coexistencia entre las iniciativas reguladoras por parte de los Estados, aquellas por parte actores no-Estados, y el mercado. Todo ello en un contexto de creciente hiperconectividad.

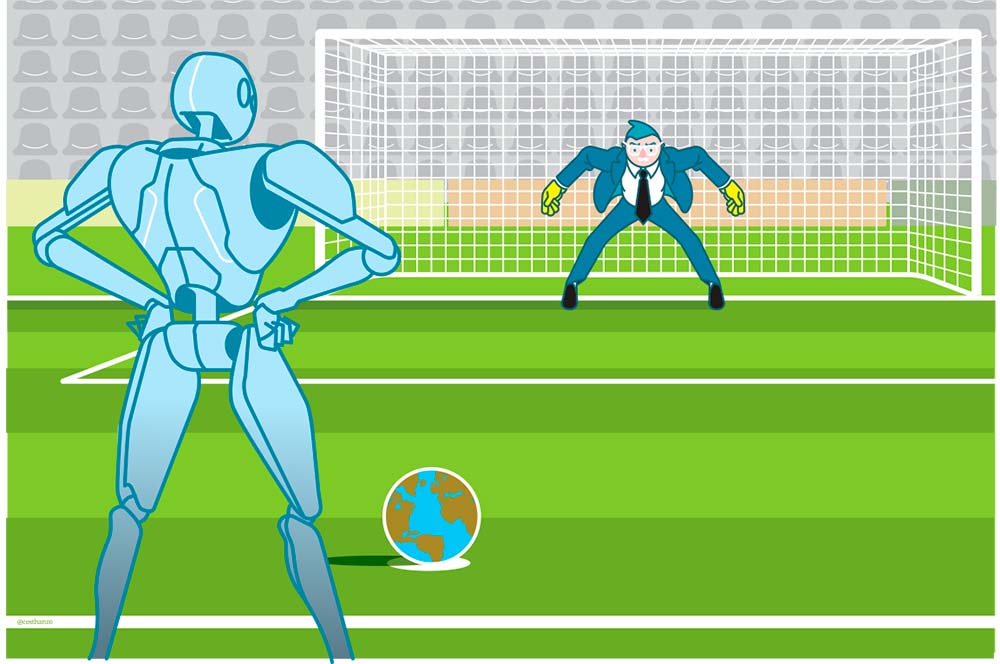

Tomando como base el trilema de Rodrik sobre la integración económica global, se podría argumentar que actualmente nos encontramos ante un trilema político de la gobernanza tecnológica, que ilustra la compleja interacción entre el Estado, la sociedad y las fuerzas del mercado en el avance tecnológico. Esta conjetura plantea que no es posible lograr simultáneamente una gobernanza global de la IA, mantener la soberanía nacional y fomentar los valores democráticos.

Estamos ante un trilema político de la gobernanza tecnológica, una compleja interacción entre el Estado, la sociedad y las fuerzas del mercado tecnológico

Mucho se ha hablado de la necesidad de una gobernanza global de la inteligencia artificial. Sin embargo, el establecimiento de modelos y normas comunes que sean efectivos a nivel mundial requiere una coordinación sin precedentes entre países con distintos intereses políticos, económicos y sociales. Un enfoque global puede ayudar a prevenir la carrera a la baja en términos de ética y seguridad, pero plantea interrogantes sobre cómo integrar diversas perspectivas culturales y normativas sin suprimir la innovación o, quizás lo más importante, el pluralismo cultural. Este balance es crucial para evitar que la regulación de un país o un pequeño grupo de países domine o limite el desarrollo y despliegue global de nuevas tecnologías.

En contraste con la gobernanza global, la soberanía nacional puede verse amenazada o reforzada, dependiendo de cómo se implementen las políticas a nivel internacional. Los gobiernos tienen naturalmente la presión de proteger sus propias industrias y la privacidad de sus ciudadanos, a la vez que no pueden dejar de participar en un mercado que es global. Asimismo, la adopción de políticas de IA alineadas solo con intereses nacionales puede llevar a una fragmentación del mercado global. En este sentido, los países deben evaluar hasta qué punto pueden y deben ceder control para la participación en iniciativas regulatorias más amplias enfocadas en el beneficio para la humanidad en su conjunto, sin que se lleguen a comprometer los principios fundamentales y su propia autonomía.

El aspecto más delicado del trilema es cómo la IA afecta los valores democráticos. La inteligencia artificial tiene el potencial de fortalecer la democracia —por ejemplo, mejorando la transparencia, la participación ciudadana y la eficiencia de los servicios públicos—. Pero también tiene la capacidad de erosionarla, siendo ejemplos habituales en este sentido la vigilancia masiva o el uso indebido de datos personales. La dificultad radica en desarrollar una gobernanza de la IA que no solo sea técnica o económica, sino profundamente ética, asegurando que la tecnología sirva al bien público y respete y proteja los derechos fundamentales. Las decisiones sobre cómo se diseñan, implementan y regulan estas tecnologías pueden reforzar o debilitar el tejido democrático, haciendo esencial una deliberación pública amplia y un compromiso firme con los principios democráticos en cada paso del desarrollo y despliegue de la IA.

El debate subyacente del trilema político de la gobernanza de la tecnología refleja los ya de sobra conocidos desafíos de la gobernanza de internet y su intento de alcanzar un modelo que equilibre las demandas de una sociedad hiperconectada, los impactos revolucionarios de la tecnología en la sociedad, y la democracia. Los primeros días de internet se caracterizaron por una actitud de laissez-faire encapsulada en el adagio “si no está roto, no lo arregles” (if it ain’t broke, don’t fix it). En contraste, el enfoque actual hacia la IA reconoce que los riesgos inherentes requieren medidas proactivas.

La adopción de principios de IA por parte del G20 en 2021, el proceso de la IA de Hiroshima del G7 en 2023, y las numerosas estrategias nacionales de inteligencia artificial subrayan un consenso global sobre la importancia de avanzar en las tecnologías de IA. Hace tan solo unas semanas, la UE acaba de aprobar una legislación exhaustiva (el Reglamento Europeo de Inteligencia Artificial —AIA: Artificial Intelligence Act—). Por su parte, el Consejo de Europa acaba de publicar un convenio marco, vinculante sobre IA, derechos humanos, democracia y Estado de derecho, y la UNESCO ha adoptado recomendaciones sobre la ética de la IA. Además, la ONU ha establecido un Grupo de Expertos en IA para guiar los esfuerzos regulatorios globales. Estas iniciativas reflejan un consenso amplio sobre la necesidad de regular la IA para maximizar sus beneficios y minimizar sus riesgos.

A pesar de este consenso, las opiniones sobre la naturaleza de la regulación de la IA varían significativamente. Algunos abogan por regulaciones detalladas con responsabilidades claramente definidas, incluyendo prohibiciones sobre aplicaciones de IA que violen la dignidad humana. Otros proponen regulaciones marco que establezcan principios generales y pospongan las reglas detalladas hasta que se comprendan mejor las consecuencias de aplicaciones específicas. La Cumbre de Seguridad de la IA organizada por Reino Unido en Londres en noviembre de 2023 ilustra esta ambigüedad. La resultante Declaración de Bletchley de la cumbre enfatiza la identificación de riesgos de la IA y el desarrollo de políticas apropiadas. Sin embargo, no especifica medidas concretas.

Las implicaciones geopolíticas de la IA añaden otra capa de complejidad al trilema. Países como China, Rusia, India, Brasil y Sudáfrica están desarrollando sus propias estrategias nacionales de IA, reflejando la importancia estratégica de la IA en las dinámicas de poder global.

La dimensión geopolítica de la IA se complica aún más por sus aplicaciones militares. Por ejemplo, las cámaras de vigilancia instaladas en las principales ciudades ucranianas para proteger la seguridad pública son ahora utilizadas por hackers rusos como una vía de acceso para el reconocimiento militar. En Gaza, el ejército israelí utiliza reconocimiento facial generado por IA para identificar y eliminar a combatientes de Hamás. La tecnología se convierte, básicamente, en un arma. Además, las discusiones de la Asamblea General de las Naciones Unidas sobre los sistemas de armas autónomas letales o LAWS (Lethal autonomous weapons) y la reciente resolución de la ONU iniciada por Austria reflejan crecientes preocupaciones sobre una carrera armamentista de IA.

Ante esta situación, resulta esencial que se revisen y actualicen los acuerdos fundamentales que definen los derechos, las responsabilidades y la distribución de poder dentro de la sociedad para garantizar la protección de los valores democráticos en un contexto geopolítico cambiante. En otras palabras, se precisa repensar el contrato social en la era de la IA.

Fijar modelos y normas que sean efectivos a nivel mundial requiere una coordinación sin precedentes entre países

El Reglamento de la UE para la IA tiene como objetivo crear un marco centrado en el ser humano, con la esperanza de replicar el éxito del Reglamento General de Protección de Datos (RGPD) en el establecimiento de modelos globales en sintonía con los valores democráticos europeos. Sin embargo, la complejidad y la rápida evolución de la IA presentan retos particulares que difieren de los que surgieron durante el desarrollo de la gobernanza de internet. Ahora, la revisión del contrato social debe tener en cuenta la aparición de nuevos espacios para el debate democrático, sustentados en datos y algoritmos.

La cuestión que se plantea, por tanto, es la de reconciliar estos nuevos espacios, que son transfronterizos y están gobernados por actores privados, con la democracia y con la propia existencia del Estado. Esto provoca que el Estado tenga que competir más fuertemente con el mercado y con la sociedad hiperconectada en la carrera por liderar la gobernanza de la IA.

De manera similar a las conclusiones de Rodrik sobre la economía global, cualquier reforma del sistema de gobernanza global debe abordar el trilema político de la gobernanza de la IA. Sin entrar en el debate regulación versus innovación, el avance en el proceso de hiperconectividad e innovación requiere ceder parte de nuestra democracia, o bien de soberanía digital.

Daly, A., et al. (2019): “Artificial intelligence governance and ethics: global perspectives”, en arXiv preprint arXiv:1907.03848, 2019.

Innerarity, D. (2024): Inteligencia artificial y democracia. UNESCO. Disponible en: https://www.unesco.org/es/articles/inteligencia-artificial-y-democracia

Robles Carrillo, M. (2020): “Artificial intelligence: From ethics to law”, en Telecommunications policy, 44(6), 101937.

Rodrik, D. (2007): The inescapable trilemma of the world economy. Disponible en: https://rodrik.typepad.com/dani_rodriks_weblog/2007/06/the-inescapable.html

Investigadora de la School of Transnational Governance (EUI) y profesora asociada de Derecho de las Tecnologías de la Información en la Universidad de Tartu. Es doctora en Derecho y tiene un máster en Derecho Comparado, Europeo e Internacional por el Instituto Universitario Europeo.

Ver todos los artículos

Investigadora de la School of Transnational Governance (EUI) y profesora asociada de Derecho de las Tecnologías de la Información en la Universidad de Tartu. Es doctora en Derecho y tiene un máster en Derecho Comparado, Europeo e Internacional por el Instituto Universitario Europeo.

Ver todos los artículos