El abrigo blanco de la desinformación

Plataformas digitales, bulos e impacto intergeneracional en tiempos de IA

27 de noviembre de 2024

por

Patricia Ruiz Guevara

Ilustrador

Ana Galvañ

Cuando era niña, la oferta de lugares donde comprar ropa en mi ciudad no era muy extensa. Fui creciendo, las posibilidades aumentaron y, en cierto momento, se volvieron casi ilimitadas: las tiendas pasaron de ser solo físicas a volverse digitales. Más estilos, más pluralidad, gustos para todas las edades. Pero al comprar online también es más difícil acertar con la calidad, la procedencia, y puede que incluso te lleves alguna estafa y falsificación por el camino.

En cierto modo, con la información ha sucedido lo mismo. Hemos pasado de elegir entre unos cuantos periódicos en el quiosco del barrio, a incontables medios digitales, webs, portales y redes sociales donde pululan contenidos que a veces sí son noticia, pero otras no. En estas plataformas digitales se mueven cada día toneladas de desinformación, y cada cual decide si la compra y se la cree, o si comprueba y cambia de pestaña. Es una moda que no atiende a divisiones generacionales: todos estamos expuestos a creernos los bulos que nos llegan, aunque interactuamos con ellos de formas diferentes. Los mayores son más vulnerables porque dominan menos el entorno digital, pero a los jóvenes les cuesta más identificar qué es una noticia y confiar en los medios de comunicación.

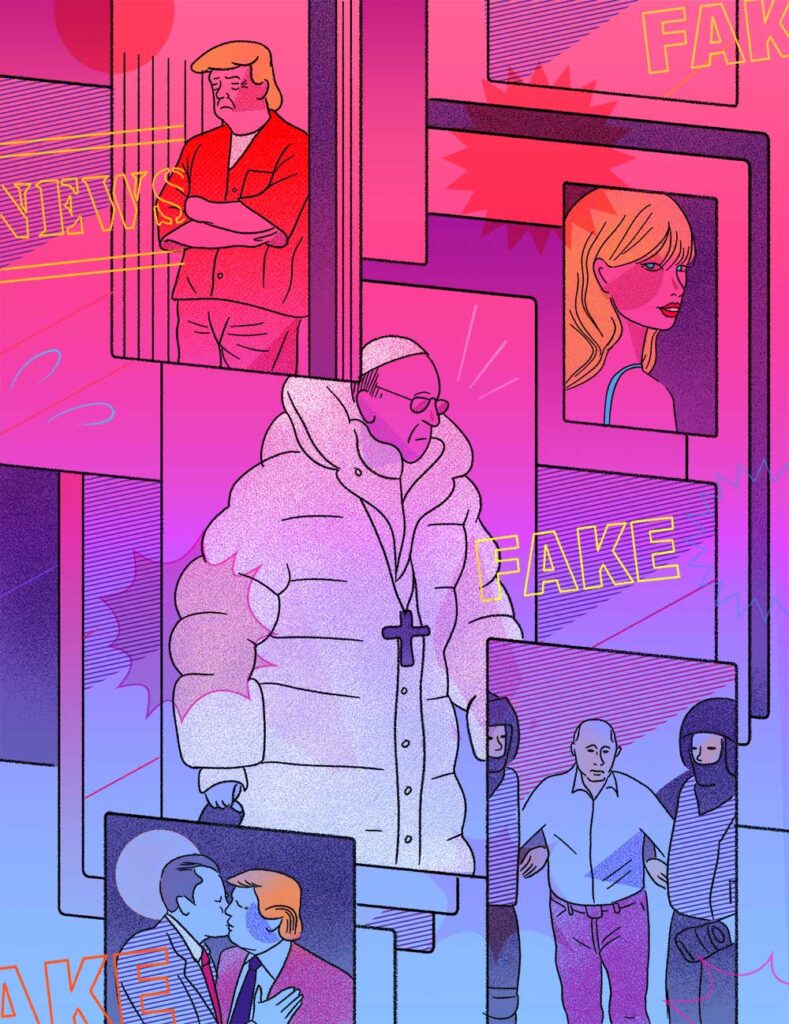

En este mercado copado, irrumpe la revolución de la inteligencia artificial (IA) generativa, que está haciendo que cada vez sea más difícil dilucidar si lo que vemos en internet es real o no. ¿No nos creímos todos, al menos durante unos segundos, que el papa Francisco se había puesto un abrigo de plumas blanco de Balenciaga en marzo de 2023? Comprar abrigos (y crearlos con IA) ahora está al alcance de un clic, pero también la desinformación.

Parece evidente que adquirir prendas de ropa es algo necesario para las personas. Si cambian los lugares donde comprar, hay que adaptarse. ¿Es igual de evidente que hay que estar informado, aunque cambien el dónde y el cómo? Los quioscos y la producción de noticias han evolucionado pero, según datos del Digital News Report España 20241, estamos desencantados con el consumo de información.

La desconexión informativa ha crecido en los últimos años. Estamos por debajo de la media a nivel mundial y entre los países europeos que menos atención prestan a las noticias. El interés ha caído del 85 por ciento en 2015 al 52 por ciento actualmente. De media, el 37 por ciento de los españoles dice que intenta evitar las noticias (ocho puntos más que en 2023), y en este porcentaje hay una brecha generacional. El rechazo sube al 44 por ciento entre menores de 35 años, y baja al 35 por ciento en los mayores de esa edad.

Unido a esto está la desconfianza en las noticias, donde también hay diferencias: a menor edad, mayor escepticismo. Entre los 18 y 24 años solo se fían un 19 por ciento de jóvenes españoles y un 23 por ciento entre 25 y 34 años; esto sube a más del 40 por ciento en mayores de 55 años.

Más desconexión, más desconfianza y también más preocupación por los bulos que proliferan en internet. De nuevo, son las personas mayores las más preocupadas por discernir qué es cierto y qué es falso, pero la diferencia no es tan acusada. Cerca de tres de cada cuatro españoles de más de 45 años (un 73 por ciento) están preocupados y, por debajo de esa edad, aproximadamente dos de cada tres (un 64 por ciento). La preocupación no está injustificada. Según datos de Statista de 2022, casi una tercera parte de los europeos de entre 15 y 39 años cree haber estado expuesto a desinformación a menudo o muy a menudo, cifra que baja ligeramente en los mayores de 40.

Frente a la apatía, el desencanto y la preocupación, especialmente los jóvenes se han distanciado de los medios tradicionales y buscan plataformas digitales para informarse, pero no son los únicos. Las redes sociales ya son la principal puerta de entrada a las noticias digitales, y la edad influye en cuáles y en cómo.

Los menores de 35 años prefieren Instagram (29 por ciento), X —antes Twitter— (28 por ciento) y TikTok (23 por ciento), mientras que los mayores de esa edad optan por informarse en Facebook (30 por ciento), WhatsApp y YouTube (23 por ciento). Una vez dentro de una red social, no nos fiamos igual de todos los mensajes, y esto es clave para caer o no ante la desinformación.

Analicemos el caso de TikTok. En la red social china, su algoritmo feroz personaliza lo que vemos al abrir la aplicación en base a nuestras interacciones y arroja un vídeo corto tras otro. Algo que puede tener aspecto de noticia puede aparecer sin más; de hecho, la generación Z tiende a encontrar información en base a motivaciones sociales, más que a buscarla adrede2. Aunque a los más jóvenes les sobren conocimientos digitales, eso no subsana que puedan tomar por noticia algo que no lo es.

A esto le añadimos que la gente cada vez confía más en los vídeos para informarse y es menos probable que se cuestione de forma crítica un contenido audiovisual, breve y de fácil consumo que cuenta gente corriente, especialmente entre los más jóvenes. Pero en TikTok hay mucha, muchísima desinformación, como bulos sobre cambio climático y migración o teorías de la conspiración. ¿Nos creemos capaces de distinguirla? Un 28 por ciento de los mayores de 65 años considera que no es nada fácil diferenciar entre noticias fiables y no fiables en TikTok, frente a un 47 por ciento de los menores de 25 años.

En WhatsApp el escenario es otro. Un 51 por ciento de los mayores de 65 años confía en la posibilidad de distinguir la desinformación en la aplicación de mensajería de Meta, pero a la vez es una plataforma en la que son más vulnerables. Igual que las personas de edad avanzada se suelen sentir más cómodos comprando en tiendas donde están familiarizados con la persona que los atiende, se fían más de aplicaciones donde reciben contenidos de conocidos. Sin embargo, confiar más en un contenido solo porque viene de un familiar o amigo no es necesariamente bueno. Ahí están los miles de ejemplos de cadenas de WhatsApp sobre virus, vacunas, estafas o medidas políticas que difunden desinformación.

A esa difusión todos contribuimos, pero no en la misma medida: según estudios, los usuarios de edad avanzada son quienes más comparten contenidos falsos (a sabiendas o no). Por ejemplo, durante las elecciones estadounidenses de 2016, en comparación con usuarios jóvenes, los mayores de 65 años compartieron en Facebook siete veces más enlaces a dominios con desinformación3. Por su parte, los jóvenes aseguran que no tienen intención de difundir contenidos falsos. Cuando reciben una noticia (o algo que se lo parece), la mitad de los jóvenes españoles dice advertir a quien se la envía si creen que es falsa, y siete de cada 10 borran contenidos de sus redes sociales si averiguan que son bulos4.

Aunque los bulos existen desde que el ser humano se comunica, los cambios llegan, como en todo. Con la irrupción del prêt-à-porter (la producción en serie) en el mundo de la moda, el diseñador español de alta costura Cristóbal Balenciaga decidió en 1956 retrasar la presentación a prensa de sus colecciones un mes más tarde de lo que las mostraba a sus clientas (contra la práctica estipulada en París, donde tenía su maison). Contrario a todo lo que supusiera perder el control sobre sus ideas, lo hizo para proteger sus diseños por temor a copias y falsificaciones5.

¿Qué habría pensado Balenciaga del actual modelo de negocio en la industria? ¿Y de la inteligencia artificial y la manipulación de imágenes? ¿Le gustaría el abrigo generado con IA asociado a su marca que se hizo viral? Para crear la famosa imagen del papa Francisco enfundado en un plumas blanco, su autor usó el programa de IA Midjourney6 y le dió como instrucciones (prompts) “El Papa con un abrigo acolchado de Balenciaga, Moncler, caminando por las calles de Roma, París”.

La imagen, de aspecto hiperrealista, aunque con algunos errores típicos de los comienzos de este tipo de herramientas de IA generativa, se compartió en un subforo de Reddit y luego saltó a redes sociales. El impacto fue mayúsculo y gente de todas las edades se lo creyó. Aunque ya se habían hecho virales otras imágenes generadas con IA, el abrigo blanco del papa fue el primer caso de desinformación masiva con un contenido generado con IA, un punto de inflexión en la difusión de bulos en internet. Hasta entonces, se había registrado muy poca desinformación relacionada con IA y no había habido una cobertura de verificación tan amplia para un contenido hecho con esta tecnología7.

Puede parecer baladí que alguien crea que el papa Francisco ha llevado una prenda u otra, pero alrededor de cualquier bulo se puede construir una narrativa. Quizá los jóvenes fantasearan con la idea de un pontífice a la última, pero otros católicos mayores pensaran que el papa despilfarra dinero y que su iglesia no cumple con sus principios.

Desde entonces, hemos visto cientos de casos generados con IA, tanto en imagen como en vídeo, que han circulado por foros, redes sociales y apps de mensajería. Se usan para desinformar en contextos de guerra, como Ucrania e Israel y Palestina; en campañas políticas, como Donald Trump con la imagen manipulada de Taylor Swift; para crear contenido sexual sin el consentimiento de las víctimas (en su mayoría mujeres) y para estafar8.

Estos usos de la IA nos empiezan a quitar el sueño. Según una encuesta del Centro de Investigaciones Sociológicas (CIS), a tres de cada cuatro españoles les preocupa mucho o bastante que no podamos distinguir si las imágenes o vídeos que vemos en internet son reales o no, y la manipulación de imágenes para crear contenido falso.

Si la exposición a la desinformación ya era un problema intergeneracional, ahora también lo son los riesgos que añaden los malos usos de la IA. Por el bien de las sociedades, es vital que sus ciudadanos puedan tomar decisiones informadas. Algo que puede parecer nimio, como recibir bulos sobre el tiempo atmosférico, podría hacer que alguien saliera con un plumas en plena ola de calor o en manga corta en una nevada. En lugar de enfundarnos sin pensar el abrigo blanco de la desinformación y hacer que Balenciaga se revuelva desde el más allá, podemos luchar contra la falsificación.

Desde dentro, las compañías tecnológicas deben velar por la protección de sus usuarios y ayudar a reducir la desinformación en sus plataformas bajo las consideraciones que dicta la Ley de Servicios Digitales (DSA) de la Unión Europea. Desde fuera, podemos promover espacios y contenidos adaptados a cada generación que despierten el espíritu crítico y mejoren la alfabetización mediática, expliquen cómo se consume información y se interactúa en las distintas apps y redes sociales, y enseñen a identificar qué es un bulo y qué una noticia. Y siempre, ante la duda, es tarea de cada uno no compartir y contribuir a expandir la desinformación. Eso nunca será una buena moda.

1Novoa-Jaso, M. F., Sierra, A., Labiano, R. y Vara-Miguel, A. (2024): Digital News Report España 2024. Calidad periodística y pluralidad: claves para la confianza informativa en la era de la inteligencia artificial (IA). Servicio de Publicaciones de la Universidad de Navarra.

2Hassoun, A., Beacock, I., Consolvo, S., Goldberg, B., Gage Kelley, P. y Russell, D. M. (2023): “Practicing Information Sensibility: How Gen Z Engages with Online Information”. Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems. Artículo Nº 662, P. 1-17.

3Brashier, N. M., y Schacter, D. L. (2020): “Aging in an Era of Fake News”. Current Directions in Psychological Science, 29(3), 316-323.

4Vicente Domínguez, A. M., Beriain Bañares, A. y Sierra Sánchez, J. (2021): “Young Spanish Adults and Disinformation: Do They Identify and Spread Fake News and Are They Literate in It?”. Publications, 9, 2.

5Balda-Arana, A. (2013): “Cristóbal Balenciaga: una singular política de comunicación frente al avance del Prêt-à-porter”. Tesis doctoral en Universidad de Navarra. Disponible en https://dadun.unav.edu/handle/10171/48148

6Maldito Bulo (2023): “Las imágenes del papa Francisco con un abrigo de plumas blanco han sido creadas con inteligencia artificial y no son reales” en Maldita.es. Disponible en https://maldita.es/malditatecnologia/20230327/papa-francisco-abrigo-plumas-bulo-inteligencia-artificial/

7Dufour, N., Pathak, A., Samangouei, P., Hariri, N., Dudfield, A., Hernández-Escayola, P. et al. (2024): “AMMeBa: A Large-Scale Survey and Dataset of Media-Based Misinformation In-The-Wild”.

8Maldita Tecnología (2023): “Generar desinformación, suplantar identidades, humillar y estafar: los peligros de difundir sin contexto un contenido generado con inteligencia artificial” en Maldita.es. Disponible en https://maldita.es/malditatecnologia/20230322/imagenes-inteligencia-artificial-peligros-difundir-sin-contexto/

Balda-Arana, A. (2013): “Cristóbal Balenciaga: una singular política de comunicación frente al avance del Prêt-à-porter”. Tesis doctoral en Universidad de Navarra. Disponible en: https://dadun.unav.edu/handle/10171/48148

Brashier, N. M. y Schacter, D. L. (2020): “Aging in an Era of Fake News”. Current Directions in Psychological Science, 29(3), 316-323.

Dufour, N., Pathak, A., Samangouei, P., Hariri, N., Dudfield, A., Hernández-Escayola, P. et al. (2024): “AMMeBa: A Large-Scale Survey and Dataset of Media-Based Misinformation In-The-Wild”.

Hassoun, A., Beacock, I., Consolvo, S., Goldberg, B., Gage Kelley, P. y Russell, D.M. (2023): “Practicing Information Sensibility: How Gen Z Engages with Online Information”. Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems. Artículo Nº 662, P. 1-17.

Maldito Bulo (2023): “Las imágenes del papa Francisco con un abrigo de plumas blanco han sido creadas con inteligencia artificial y no son reales” en Maldita.es. Disponible en: https://maldita.es/malditatecnologia/20230327/papa-francisco-abrigo-plumas-bulo-inteligencia-artificial/

Maldita Tecnología (2023): “Generar desinformación, suplantar identidades, humillar y estafar: los peligros de difundir sin contexto un contenido generado con inteligencia artificial” en Maldita.es. Disponible en https://maldita.es/malditatecnologia/20230322/imagenes-inteligencia-artificial-peligros-difundir-sin-contexto/

Novoa-Jaso, M. F., Sierra, A., Labiano, R. y Vara-Miguel, A. (2024): “Digital News Report España 2024. Calidad periodística y pluralidad: claves para la confianza informativa en la era de la inteligencia artificial (IA)”. En el Servicio de Publicaciones de la Universidad de Navarra.

Vicente Domínguez, A. M., Beriain Bañares, A. y Sierra Sánchez, J. (2021): “Young Spanish Adults and Disinformation: Do They Identify and Spread Fake News and Are They Literate in It?” Publications, 9, 2.

Matemática y periodista especializada en ciencia y tecnología. Coordinadora de Maldita Tecnología, de Fundación Maldita.es, ha publicado en medios como El País, elDiario.es, MIT Technology Review en español y Forbes España, y ha recibido reconocimientos como el Premio Boehringer Ingelheim al Periodismo en Medicina y el Premio Comunicación de la AEPD.

Ver todos los artículos

Matemática y periodista especializada en ciencia y tecnología. Coordinadora de Maldita Tecnología, de Fundación Maldita.es, ha publicado en medios como El País, elDiario.es, MIT Technology Review en español y Forbes España, y ha recibido reconocimientos como el Premio Boehringer Ingelheim al Periodismo en Medicina y el Premio Comunicación de la AEPD.

Ver todos los artículos