Quo vadis machina?

La IA tendrá un profundo impacto en el empleo y no todo será positivo

Es uno de los conceptos de moda: inteligencia artificial (IA). En un pequeño lapso de tiempo, ha pasado de estar circunscrita a ámbitos científicos y de ciencia ficción a formar parte de la agenda de jefes de Estado, de los CEO y de un sinfín de expertos y comentaristas, elevándola a la categoría de asunto de cotidianidad mediática.

Sin embargo, en muy pocas ocasiones el debate se centra o incluye al factor trabajo. Y en las escasas ocasiones que se aborda el impacto de la IA en el empleo y en las relaciones laborales, la conversación tiende a focalizarse en aspectos exclusivamente positivos, mezclando cuestiones que llevan a confusión o equívoco. Así, vemos cómo se superponen en un mismo mensaje verdades indiscutibles del uso de la IA, como la eliminación de tareas improductivas o la creación de nuevas profesiones, con otras mucho más controvertidas como la creación neta de empleo a corto plazo para añadir otras afirmaciones directamente falsas, como la existencia de la infalibilidad algorítmica.

Que la IA está ya afectando de forma directa al entorno laboral es un hecho incontrovertible

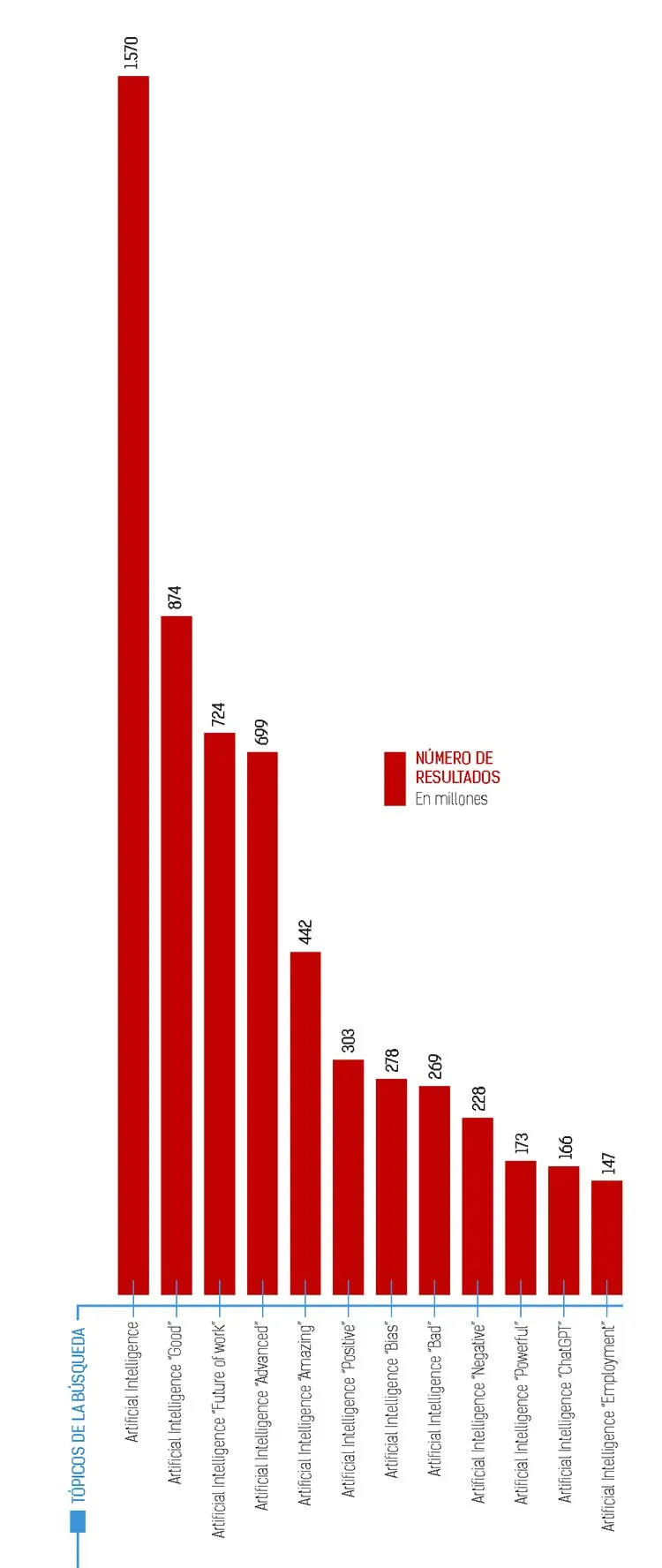

Estas tendencias se reflejan de forma muy intuitiva en los resultados del buscador de Google. Si se busca el concepto Artificial Intelligence, se encuentra la astronómica cifra de 1.570 millones de resultados. Si vamos modificando la búsqueda y cambiando el descriptor anejo al concepto inteligencia artificial, se encuentran hallazgos muy significativos:

La primera conclusión es que la IA se asocia con algo “bueno” (good) tres veces más que con algo “malo” (bad). Además, los adjetivos que más entradas acumulan son aquellos que le aportan un aspecto francamente positivo (“avanzada”, “maravillosa”, “poderosa”: “advanced”, “amazing”, “powerful”), muy por encima de los que le asocian parcialidad o sesgos (bias). En suma, las entradas que transmiten una idea positiva de la IA son un 25 por ciento superiores a las negativas.

Luego está el apartado del trabajo y del empleo. La vinculación de la IA y futuro del empleo está entre las tendencias más populares, pero de un rápido vistazo se comprueba que bajo esa búsqueda se aglutina un confuso compendio de nuevas profesiones, oportunidades de empleo y ofertas formativas (normalmente de carácter privado e integradas sin solución de continuidad en el mismo texto). Con todo, lo más llamativo es que, si relacionamos los conceptos IA-empleo, los resultados no lleguen ni al 10 por ciento del total de entradas.

Con todas las cautelas metodológicas que debe tener una aproximación de estas características, se pueden alcanzar dos conclusiones: en general, la IA es percibida como algo positivo, muy por encima de representar un riesgo, postergando las entradas negativas en favor de una descripción de la IA como una tecnología superlativa. Y dentro de toda la información que transcurre por la red de redes, la afectación de aquella al empleo no es un aspecto que preocupe/destaque en demasía, salvo si concurre un contexto en donde el objetivo es publicitar la formación sobre IA.

Sin embargo, lo que nos transmite un buscador de Internet, no tiene por qué coincidir con la opinión pública. De hecho, la ciudadanía demuestra un sentir muy diferente. Así, la última Encuesta de Percepción Social de la Ciencia y la Tecnología en España, publicada por la Fundación Española para la Ciencia y la Tecnología (FECYT), detectaba que un 73 por ciento de la ciudadanía pensaba que la introducción de robots en los puestos de trabajo contribuye de forma importante a aumentar el riesgo de desempleo, a la par que entendía que no existía relación entre la IA y el incremento en la competitividad de las empresas (54,5 por ciento). Además, resultaba significativo que se registre un porcentaje mayor de personas que considera que estos avances tecnológicos entrañan más riesgos que beneficios (45,4 por ciento frente al 39,5 por ciento).

La Fundación COTEC publica periódicamente un análisis similar (Encuesta de percepción social de la innovación en España). En la de 2023 volvemos a encontramos con interesantes propensiones: la mitad de los encuestados se inclina por secundar que la innovación tecnológica aumenta la desigualdad social (frente a un 29 por ciento que no corrobora este extremo) y 6 de 10 personas consideran que la mayoría de los puestos de trabajo del presente serán realizados por máquinas en los próximos años.

Conforme a estos datos, parece más que evidente que la ciudadanía española ve con preocupación el impacto de las nuevas tecnologías sobre el empleo. Recordemos que ambos sondeos se realizaron antes de la irrupción mediática —y universalmente accesible— de ChatGPT. Es fácil sospechar, sin mucho margen de error, que en las siguientes ediciones estos temores se agudizarán.

Empero, este generalizado recelo a la masificación de la IA en los centros de trabajo parece no alcanzar ni a legisladores ni a reguladores, como si se diese más importancia a los resultados del algoritmo de Google que a los sentimientos y opiniones de las personas.

La mayor prueba de esta disonancia la tenemos en el primer trabajo del Grupo de Alto Nivel sobre Inteligencia Artificial, que apadrinaba la Comisión Europea, al objeto de dar un punto de salida sobre cómo regular esta tecnología. En su documento Directrices éticas para una IA fiable, de 55 páginas, apenas aparece una única reseña al mundo del trabajo, por su “impacto social”. Ignorar el factor trabajo en la primera piedra de una futura regulación sobre IA es despreciar la realidad de millones de europeos y europeas, donde tener empleo significa tener sustento y en donde invertimos un tercio de nuestras vidas.

Como resultado de la acción de muchos sindicatos y asociaciones, la AI Act, la futura Ley de inteligencia artificial de la UE, parece haber corregido este extremo al considerar la IA aplicada a las relaciones laborales como una actividad de alto riesgo. Sin duda, llegará con retraso. No sabemos exactamente cuándo, puesto que se desconoce su fecha de entrada en vigor.

Y dicha Ley de IA llegará tarde porque la IA desregulada ya está imbuida en nuestro tejido productivo, especialmente en España. El INE confirma que, en 2022, un 21 por ciento de las empresas de menos de 10 empleados usó IA para automatizar flujos de trabajo. En el caso de las empresas de más de 10 personas trabajadoras este porcentaje se dobla, alcanzando el 46 por ciento.

Dos estudios europeos de Eurofound reafirman esta capilaridad. En The platformisation of work, el organismo europeo revelaba que un 34,7 por ciento de las personas trabajadoras están gobernados por alguna suerte de algoritmo (en Alemania, ni un 19 por ciento de las plantillas se encontraba en esta situación). En Employee monitoring and surveillance: The challenges of digitalisation se señalaba que hasta un 40 por ciento de las empresas españolas estarían usando algoritmos para la monitorización de la actividad laboral y para evaluar el desempeño de las personas trabajadoras, colocando a España en el dudoso honor de liderar esta estadística en toda Europa (el único ranking digital donde la economía española está en cabeza).

Que la IA está ya afectando de forma directa al entorno laboral es un hecho incontrovertible, y por tres vías principales.

La primera, relacionada con el volumen de empleo. Veamos dos ejemplos muy significativos: IBM, uno de los mayores suministradores del mundo de IA, ha afirmado oficialmente que las tareas de 8.000 puestos de trabajo que iba a realizar con contrataciones humanas, los va a suplir con esta tecnología. British Telecom, uno de los operadores de telecomunicaciones más importantes del mundo, ha presentado un plan de despidos que afectará a 55.000 personas. Las tareas que les correspondería realizar a 10.000 de estas personas se harán mediante IA. Estamos solo ante la punta del iceberg: Goldman Sachs afirmó que la inteligencia artificial generativa podría dejar sin empleo a 300 millones de trabajadores entre Estados Unidos y Europa, y el Foro Económico Mundial predice una reducción de 14 millones de puestos de trabajo en los próximos cuatro años. Demasiadas señales para ser consideradas como algo anecdótico.

La segunda vía es la relacionada con la negociación colectiva, a la que ya está condicionando de forma muy sustantiva. En Hollywood, la respuesta de las patronales a la huelga de guionistas es “no seáis muy exigentes, porque si no encargaremos los guiones a la IA”. No es el primer caso; hace unos años, el CEO de McDonald’s arguyó algo semejante blandiendo la amenaza de brazos robóticos soportados por IA (el primer establecimiento de la cadena sin humanos se abrió en a finales de 2022 en Texas).

La tercera vía, más soterrada pero cada vez más emergente, versa sobre si las decisiones de la IA en las relaciones laborales están libres de decisiones injustas, sesgadas o directamente discriminatorias. Varios estudios europeos señalan que la IA y la algoritmia tienen un potencial efecto negativo sobre nueve derechos humanos fundamentales (como el derecho a la dignidad humana, a la integridad personal, al respeto a la intimidad o a la no discriminación).

No obstante, y según el IBM Global AI Adoption Index 2022, el 74 por ciento de las empresas no reducen el sesgo no deseado y un 60 por ciento no desarrollan políticas éticas relacionadas con la inteligencia artificial. Si a esta evidencia le unimos que, al menos, un 46 por ciento de las empresas españolas ya usan algún tipo de IA laboral sin que conste supervisión humana ni evaluación de impacto previa, ni protección de datos desde el diseño, ni auditorias ex ante o ex post, deberíamos estar poniéndonos en lo peor.

Por ello cobra especial importancia en el V Acuerdo para el Empleo y la Negociación Colectiva, que dedica un capítulo entero a cómo los futuros convenios deben regular la IA, una estipulación pionera en Europa.

Los cuatro firmantes (UGT, CC. OO., CEOE y CEPYME) partimos de un consenso: la IA tendrá un impacto significativo en el mundo laboral y su uso inadecuado podría desembocar en unas relaciones laborales discriminatorias o con tratamientos sesgados.

La negociación colectiva debe desempeñar un papel fundamental estableciendo criterios que garanticen un uso adecuado de la IA

Partiendo de dicha base, consagramos dos principios fundamentales: garantizar el control humano de la IA —aportando así seguridad y criterio al funcionamiento de esta tecnología— y aportar transparencia al funcionamiento de los algoritmos a través del ejercicio del derecho a la información. Dicho derecho ya se articula en el Estatuto de los Trabajadores en su artículo 64.4.d, que obliga a facilitar información “transparente y entendible sobre los procesos que se basen en ella [la IA] en los procedimientos de Recursos Humanos (contratación, evaluación, promoción y despido)”, garantizándose así “que no existen prejuicios ni discriminaciones”.

Con estas premisas, ambas partes declaramos que la “negociación colectiva debe desempeñar un papel fundamental estableciendo criterios que garanticen un uso adecuado de la IA y sobre el desarrollo del deber de información periódica a la representación de los trabajadores”, llegando a ampliar este llamamiento a los sistemas de IA en las Administraciones públicas, a las que instamos a seguir igualmente el principio de control humano y transparencia.

El reto que tenemos por delante es mayúsculo. Regular con buen tino una tecnología tan compleja y vertiginosa como es la inteligencia artificial requerirá de un gran esfuerzo colectivo, exigiendo, a todas las partes, preparación, pericia y audacia. Pero el bien superior perseguido vale la pena: la IA tiene que contribuir a crear entornos laborales cimentados en la igualdad de oportunidades, la dignidad y la empleabilidad. Lo contrario, no es admisible.

Dirección General de Redes de Comunicación, Contenido y Tecnologías (Comisión Europea), Grupa ekspertów wysokiego szczebla ds. sztucznej inteligencji (2019): Directrices éticas para una IA fiable. Disponible en: https://data.europa.eu/doi/10.2759/14078

Eurofound (2020): Employee monitoring and surveillance: The challenges of digitalisation. Luxemburgo, Publications Office of the European Union.

Fernández-Macías, E., Urzi Brancati, M. C., Wright, S. and Pesole, A. (2023): The platformisation of work. Luxemburgo, Publications Office of the European Union.

Fundación COTEC (2022): Percepción social de la innovación en España. Disponible en: https://cotec.es/observacion/encuesta-de-percepcion-social-de-la-innovacion/6a81446c-6656-94e3-5d74-f8328ce1ca0b

Fundación Española para la Ciencia y la Tecnología (FECYT), (2022): Encuesta de Percepción Social de la Ciencia y la Tecnología en España (EPSCT). Disponible en: https://www.fecyt.es/es/publicacion/percepcion-social-de-la-ciencia-y-la-tecnologia-en-espana-2022

Goldman Sachs (2023): Generative AI could raise global GDP by 7%. Disponible en: https://www.goldmansachs.com/intelligence/pages/generative-ai-could-raise-global-gdp-by-7-percent.html

IBM: IBM Global AI Adoption Index 2022. Disponible en: https://www.ibm.com/watson/resources/ai-adoption

INE (2022): Encuesta sobre el uso de TIC y comercio electrónico en las empresas. Disponible en:

https://www.ine.es/dyngs/INEbase/es/operacion.htm?c=Estadistica_C&cid=1254736176743&menu=ultiDatos&idp=1254735576799

V Acuerdo para el Empleo y la Negociación Colectiva (V AENC). Disponible en: https://www.ugt.es/sites/default/files/v_aenc_firma_10_05_2023_def.pdf

World Economic Forum: The Future of Jobs Report 2023. Disponible en: https://www.weforum.org/reports/the-future-of-jobs-report-2023/

Responsable de Digitalización en el Trabajo de UGT y experto en Derecho en inteligencia artificial. Ha publicado más de 50 estudios y artículos de opinión relacionados con las nuevas tecnologías y el trabajo. Es empleado de Telefónica España desde 1991.

Ver todos los artículos

Responsable de Digitalización en el Trabajo de UGT y experto en Derecho en inteligencia artificial. Ha publicado más de 50 estudios y artículos de opinión relacionados con las nuevas tecnologías y el trabajo. Es empleado de Telefónica España desde 1991.

Ver todos los artículos